Récap techno Spiria - № 380 - Raspberry Pi 5, Amazon+Anthropic, macOS Sonoma, algorithmes de compression, etc.

Le Raspberry Pi 5 arrive fin octobre !

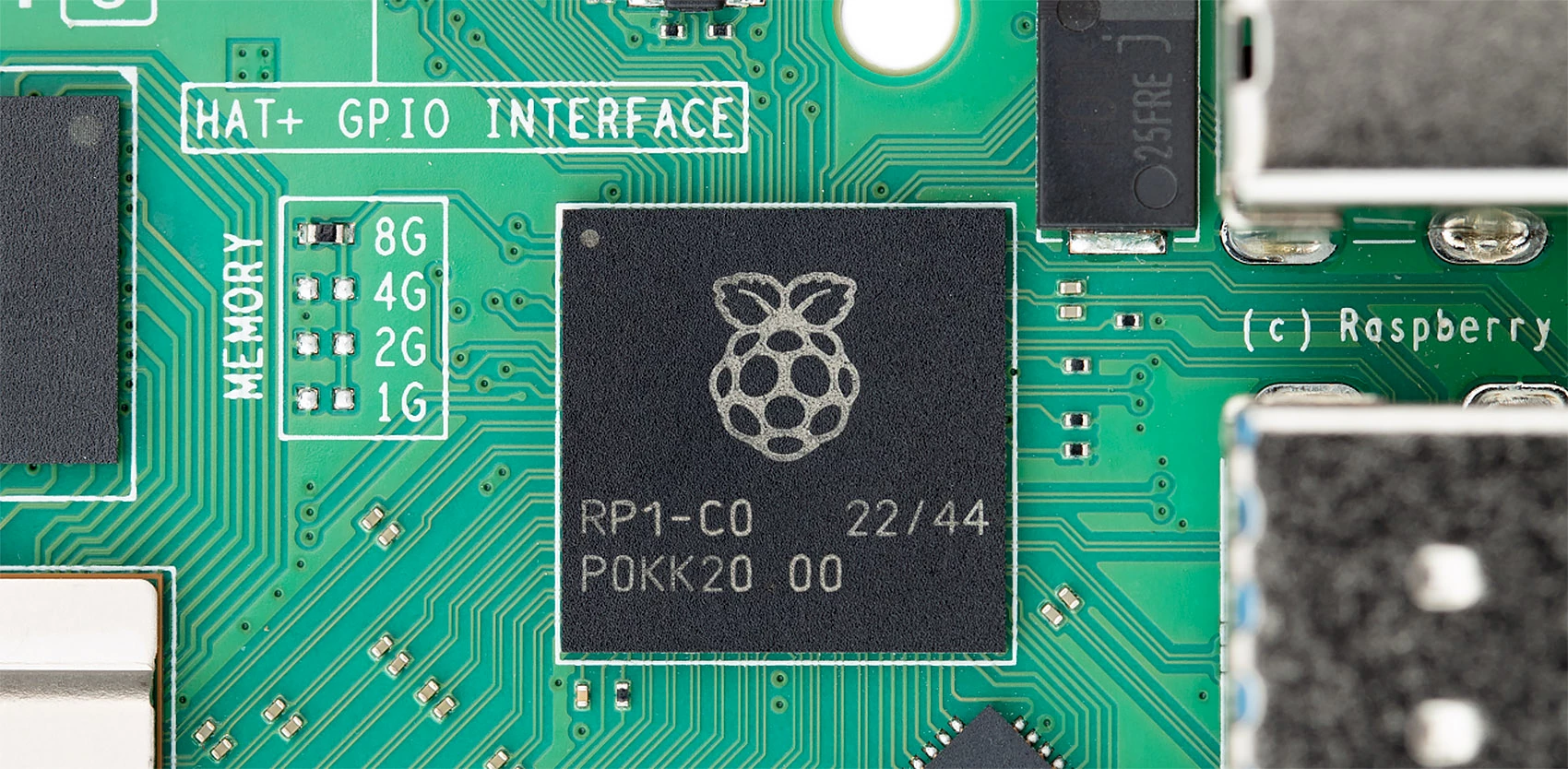

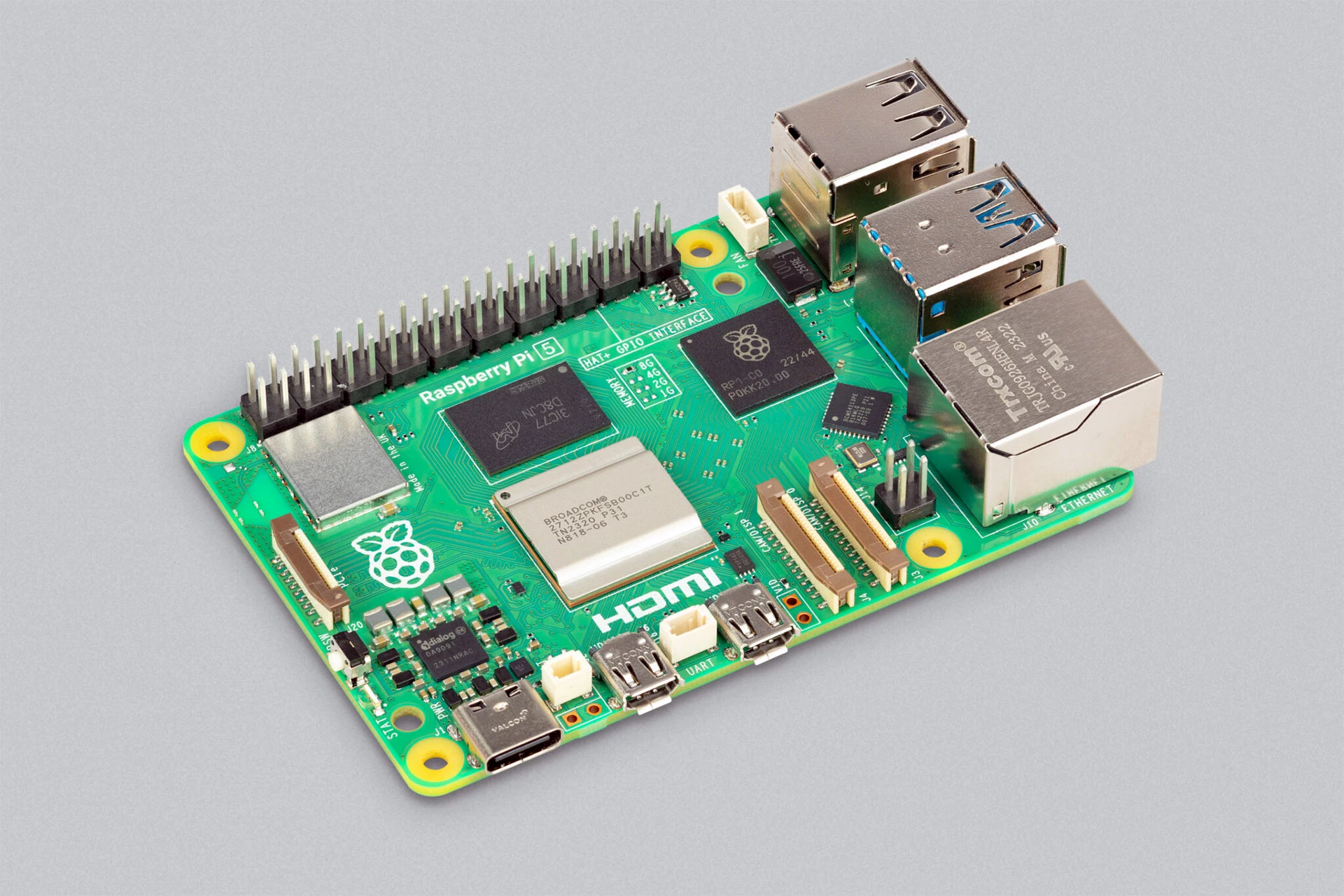

Raspberry Pi 5. © Raspberry Pi Ltd.

Le PDG de Raspberry Pi Ltd, Eben Upton, a annoncé l’arrivée fin octobre de la 5e génération de son nano-ordinateur monocarte à processeur ARM. Vendu au prix de 60 USD avec 4 Go de SDRAM et de 80 USD pour la version 8 Go, le Raspberry Pi 5 est doté de nouvelles fonctionnalités, est plus de deux fois plus rapide que son prédécesseur et il s’agit du premier ordinateur Raspberry Pi doté de silicium en grande partie conçu en interne. En effet, si son cœur est toujours un processeur Broadcom ARM quadricœur 64 bits (un Cortex-A76 qui fonctionne à 2,4 GHz), trois nouvelles puces ont été spécifiquement conçues pour lui : la VideoCore VII, un GPU plus récent et rapide, capable de piloter deux écrans HDMI 4Kp60 simultanément, la RP1, qui gère la plupart des entrées/sorties, et la DA9091, un circuit intégré de gestion de l’alimentation électrique. Les puces gérant les réseaux sans fil (Wi-Fi 802.11ac, Bluetooth 5.0 et Bluetooth Low-Energy) et la connectivité Ethernet demeurent identiques à celles du Pi 4. Extérieurement, le Raspberry Pi 5 ressemble beaucoup à ses prédécesseurs. Comme tous les produits phares de l’entreprise, le Pi 5 est fabriqué au centre technologique Sony UK à Pencoed, dans le sud du Pays de Galles.

Les Pi 5 sont disponibles en précommande dès aujourd’hui auprès de plusieurs revendeurs agréés, et les premières unités devraient être expédiées d’ici la fin octobre. Parmi les nouveaux accessoires proposés, on note un nouveau boîtier avec un petit ventilateur (10 USD), un système de refroidissement actif (5 USD), une alimentation USB-C 27 W, et une petite batterie rechargeable au lithium-manganèse pour alimenter l’horloge en temps réel (RTC) du Raspberry Pi 5 lorsque l’alimentation principale est déconnectée (5 USD).

Nouveau boîtier. © Raspberry Pi Ltd.

⇨ YouTube, “Eben Upton introduces Raspberry Pi 5”

⇨ YouTube, “Introducing Raspberry Pi 5”

⇨ The Verge, Emma Roth, “The Raspberry Pi 5 is finally here.”

⇨ Ars Technica, Kevin Purdy, “Raspberry Pi 5, with upgraded everything, available for preorder today.”

2023-09-28

Le chef des équipes Windows et Surface rejoint… Amazon

Panos Panay dévoile la Surface Pro à Shanghai en 2017. © Microsoft.

Panos Panay, qui était responsable de la gamme d’appareils Surface depuis le tout début et chef du développement de Windows depuis 2020, a soudainement quitté Microsoft il y a une dizaine de jours, juste avant l’événement présentant les nouveaux produits Surface. Ses fonctions ont alors été reprises par Yusuf Mehdi, le directeur du marketing grand public, un visage que nous connaissons pour ses présentations de la plupart des grandes annonces de l’entreprise liées à l’IA générative. Aujourd’hui, on apprend que Panay rejoint Amazon pour reprendre les rênes de la division du matériel et prendre la place de David Limp qui avait annoncé son souhait de partir en août dernier. “En tant que créateur de produits et inventeur chevronné qui possède une grande expérience dans le domaine du matériel et des services intégrés, Panos sera un atout majeur pour notre organisation dans le domaine des appareils et des services”, écrit Andy Jassy, le PDG d’Amazon, dans une note adressée à ses employés.

Panay débutera chez Amazon fin octobre, et Limp travaillera avec lui pendant les prochains mois pour l’aider à faire la transition vers ce rôle. Limp ne part pas à la retraite pour autant ; on a appris par ailleurs qu’il prendrait en décembre la direction de Blue Origin, la société spatiale détenue par l’ancien PDG d’Amazon Jeff Bezos.

⇨ Ars Technica, Andrew Cunningham, “Panos Panay, leader of the Surface and Windows teams, is leaving Microsoft.”

⇨ The Verge, Emma Roth, “Panos Panay is leaving Microsoft for Amazon.”

2023-09-28

IA : Amazon sort les crocs

Amazon + Anthropic.

Amazon a annoncé lundi qu’elle investira jusqu’à 4 milliards de dollars dans Anthropic, la jeune pousse d’IA principalement connue pour son robot conversationnel Claude et fondée par Dario et Daniela Amodei, des transfuges d’OpenAI. Cet investissement est un signal clair qu’Amazon ne souhaite pas se laisser distancer dans la course à l’armement de l’IA. Dans le cadre de l’accord, Amazon prendra une participation minoritaire dans la société et s’engage à incorporer la technologie d’Anthropic dans divers produits de son entreprise, notamment le service Bedrock d’AWS pour la création d’applications d’IA. Anthropic utilisera également les puces d’Amazon pour construire, former et déployer de futurs modèles d’IA et s’est engagée à utiliser Amazon Web Services (AWS) comme principal fournisseur de services infonuagiques.

Les chatbots Claude et Claude 2 d’Anthropic, basés sur de grands modèles de langage, sont similaires à ChatGPT d’OpenAI et à Bard de Google. Ils peuvent traduire du texte, écrire du code et répondre à diverses questions. Anthropic affirme que son modèle est plus sûr et plus fiable parce qu’il est guidé par un ensemble de principes destinés à le rendre “utile, honnête et inoffensif”.

⇨ The Verge, Jess Weatherbed, “Amazon will invest up to $4 billion into OpenAI rival Anthropic.”

2023-09-25

Ars Technica passe au crible macOS 14 Sonoma

MacOS 14 Sonoma. © Apple.

Comme à son habitude depuis des années, Ars Technica décortique toutes les nouveautés de la dernière version de macOS dans un article cette fois-ci de “seulement” plus ou moins 10 000 mots (on a connu par le passé des éditions bien plus longues, de plus de 20 000 mots — cette longueur relativement courte traduit le fait que la version Sonoma de macOS ne comporte pas vraiment de nouveautés majeures). Andrew Cunningham note que s’il n’y a pas de grandes nouveautés pour tous les types d’utilisateurs de Mac, il y a quand même un petit quelque chose pour tout le monde. Les nouveaux économiseurs d’écran et fonds d’écran sont jolis. La nouvelle implémentation des widgets est plus solide, ils sont donc pour une première fois potentiellement utiles. Le gestionnaire de mots de passe d’Apple s’enrichit de nouvelles fonctionnalités qui devraient le rendre plus fonctionnel au jour le jour. Mais à part ça, pas grand-chose de solide à se mettre sous la dent. Cunningham déplore que de plus en plus de Mac Intel soient complètement laissés sur le bord de la route, et que ceux qui restent se voient privés de fonctionnalités réservées aux possesseurs de Mac à processeur maison. Cette version de macOS apporte aussi le Game Porting Toolkit. Cela n’aura pas d’effet immédiat sur l’utilisateur, mais cela devrait faciliter l’arrivée de jeux intéressants sur la plateforme.

⇨ Ars Technica, Andrew Cunningham, “macOS 14 Sonoma: The Ars Technica review.”

2023-09-26

Les algorithmes de compression concurrencés par l’IA ?

Chinchilla. © iStock.

Dans un document de recherche arXiv intitulé Language Modeling Is Compression, des chercheurs ont utilisé Chinchilla 70B, un grand modèle de langage (LLM) de DeepMind, pour effectuer des compressions sans perte sur des images issues de la base de données ImageNet. Ils ont obtenu une compression à 43,4 % de leur taille d’origine, battant l’algorithme PNG qui a compressé les mêmes données à 58,5 %. Pour l’audio, Chinchilla a compressé les échantillons de l’ensemble de données audio LibriSpeech à seulement 16,4 % de leur taille brute, surpassant largement la compression FLAC à 30,3 %. Ces résultats suggèrent que même si Chinchilla 70B a été principalement formé pour traiter du texte, il est également étonnamment efficace pour compresser d’autres types de données, souvent meilleur que les algorithmes spécifiquement conçus pour ces tâches. Cela ouvre la porte à de nouvelles applications originales pour les grands modèles de langage.

Cela étant dit, un LLM est bien plus exigeant matériellement que des algorithmes de compression sans perte comme FLAC ou PNG qui ont été conçus pour être très légers, économes en mémoire et en énergie, tout en étant rapides. Bref, Chinchilla avec ses 70 milliards de paramètres n’est pas près de remplacer nos vaillants algorithmes pour bon nombre d’applications courantes.

⇨ Ars Technica, Benj Edwards, “AI language models can exceed PNG and FLAC in lossless compression, says study.”

2023-09-28